Analisi topometrica di superfici di componenti aeronautici

- SCOPO

Il presente rapporto, eseguito sulla base della conoscenza di problematiche complesse sottoposte dal settore della costruzione di componenti aeronautici descrive uno studio di fattibilità mirato a verificare l’applicabilità di un sistema di visione artificiale all’interno del processo di Controllo finale sul Prodotto INGRANAGGI.

2. APPLICAZIONI

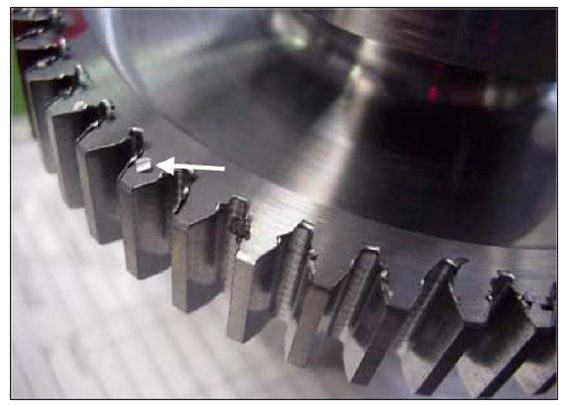

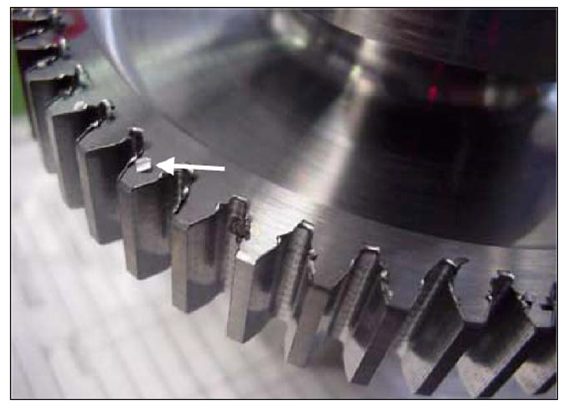

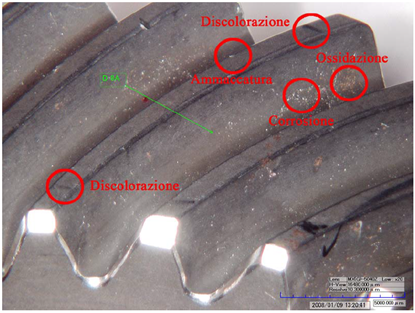

Ricerca e individuazione di DIFETTI SUPERFICIALI sul prodotto INGRANAGGI:

- Area tematica di riferimento: Ispezioni in “Collaudo FINALE”: Difetti di Origine Meccanica,

- Difetti di Origine Chimica e Cosmetici

- Tipologia di controlli e di difetti oggetto del pre-studio di fattibilità

- Metodo di collaudo visivo c/ operatore, definizione ed esempio dei principali difetti superficiali

3. OBIETTIVO

Individuare e definire i difetti rilevabili e analizzabili con esito positivo attraverso l’impiego della tecnologia di visione artificiale/visione neurale e/o metodologie alternative che in una fase sperimentale dovessero risultare idonee al raggiungimento dell’obiettivo

Precisazione:

L’obiettivo che ci si prefigge è di garantire al Costruttore di Ingranaggi e altri componenti aeronautici l’assoluta assenza di difetti su ingranaggi nelle fasi di “handling” durante il processo produttivo.

Questo fa si che il Costruttore sia disposto a considerare accettabile l’eventuale presenza, purchè in numero ragionevole, di “False Warning” (segnalazione di un difetto inesistente). Viceversa NON è assolutamente accettabile la mancata individuazione di un difetto esistente

- individuare e definire attraverso attività sperimentali l’hardware di visione più idoneo da impiegare (camera, ottica, filtri, illuminatori ecc.) e le caratteristiche necessarie dei pacchetti software di comando e di acquisizione ed elaborazione immagini

- individuare e definire la configurazione più idonea del dimostratore nella sua globalità (sistema di movimentazione ed orientamento pezzo)

FINALITA’:

- verificare la presenza delle condizioni per procedere al lancio del vero e proprio studio di fattibilità ed alla realizzazione del dimostratore (Fase2)

- individuare e definire la tecnologia più idonea da impiegare

Sperimentazioni – Analisi – Valutazioni

Fase 1 – Studio di Fattibilità

Sono state eseguite le seguenti macro attività

Analisi e valutazioni

- Presa visione e analisi preliminare di tutte le possibili tipologie di difetto (esame globale di supporto cartaceo e fotografico:

- dei difetti di varia tipologia

- delle zone e delle superfici da esaminare; esterne ed interne

- della morfologia e delle dimensioni dei componenti da esaminare

- Sopralluoghi presso i Costruttori, chiarimenti e interviste con i tecnici e con gli operatori addetti all’ispezione visiva, sulle procedure e sui metodi di controllo attualmente in utilizzo e sulle particolarità dei difetti riscontrabili.

- Analisi e definizione della/e tecnologie di visione più idonee e dell’hardware più adatto (camera, ottica, filtri, illuminatori ecc.) da impiegare per l’esame delle superfici esterne ed interne del P/N di riferimento e per l’individuazione e l’analisi dei difetti.

- Ricerca e individuazione delle migliori inquadrature da utilizzare in base alla morfologia dei pezzi, alla loro dimensione e alle superfici esterne e interne da analizzare.

- Prove di acquisizione immagini dei vari difetti e sulle varie superfici di un ingranaggio campione e di analisi delle immagini catturate.

- Valutazione sulla individuazione e sull’analisi dei singoli difetti e delle singole zonee superfici del P/N di riferimento

N.B. non si sono riscontrati difetti per i quali il controllo risulti NON fattibile

1.1.2 Test (attività eseguita presso il Costruttore dei componenti)

Test di acquisizione e di analisi delle immagini. Attività eseguita presso i Costruttori Obiettivo del test: verificare la presenza delle condizioni minime per procedere al lancio del successivo vero e proprio studio di dettaglio e alla realizzazione del dimostratore; questo sulla base delle potenzialità del sistema evidenziate dai risultati del test stesso e delle eventuali limitazioni (limitazioni per l’accessibilità alle superfici da ispezionare e/o per l’individuazione di difetti).

1.1.3 Analisi dei risultati (attività eseguita presso il Costruttore)

Tale attività consiste nello sviluppo, integrazione, messa a punto e sperimentazione dei sotto-assiemi fondamentali del sistema integrato (unità di acquisizione / illuminazione / classificazione / analisi di immagini)

Esito dello studio preliminare

1.1.4. (ANALISI E VALUTAZIONI)

Rilevazione e classificazione delle differenti tipologie di difetti

Risultano applicabili varie tecniche di analisi di immagini, visione artificiale, digitalizzazione,classificazione e confronto programmato:

- analisi e comparazione (somma e differenza) della posizione spaziale e orientamento dei singoli componenti caratteristici dell’immagine (pixels)

- analisi spettrometrica, classificazione e comparazione della distribuzione di 256 livelli di grigio e/o 16 milioni di colori

- analisi comparative morfologiche mediante soglie dimensionali

- addestramento del sistema al riconoscimento delle immagini dei difetti mediante applicazioni delle reti neurali artificiali

- evidenziazione delle proprietà geometriche locali tramite analisi di immagini a illuminazione multipla

Tutte queste tecniche, richiedono comunque che i componenti vengano acquisiti da varie direzioni di osservazione e illuminati con luce diffusa e radente, da varie angolazioni, con intensità e frequenza parametrabile e ripetibile.

Infatti l’indice di fallibilità dei sistemi di visione artificiale è fortemente influenzato dalla ripetibilità di alcuni parametri:

- inquadratura del componente e distanza dei dispositivi di acquisizione adottati

- risoluzione ottica, ingrandimento, profondità di campo, angolo di visione, banda spettrale, etc. dei dispositivi di acquisizione adottati

- riflettività, assorbimento del materiale, aberrazioni cromatiche, indice di rifrazione ….

- intensità, lunghezza d’onda, frequenza, ’angolo di incidenza, etc. delle sorgenti di luce adottate

- Sulla base delle risorse disponibili, grazie alla collaborazione di diversi produttori di scanner per l’esecuzione dello studio di fattibilità (fase 1) è stato possibile eseguire alcune prove sperimentali, mentre altre soluzioni, seppure consolidate su sistemi analoghi, sono per il momento teoriche per l’applicabilità di cui al presente studio e richiederanno la realizzazione di un prototipo ed una sperimentazione per la loro validazione.

Sistemi impiegati nello studio di fattibilità:

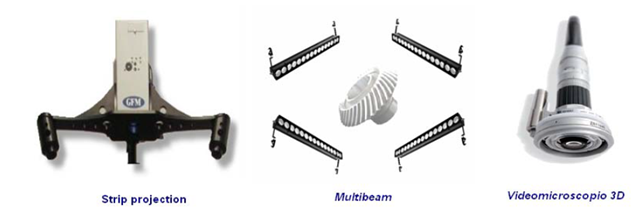

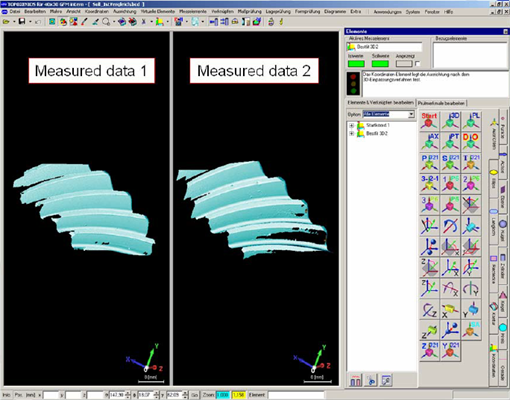

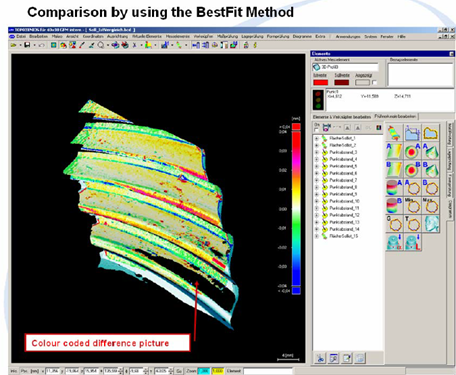

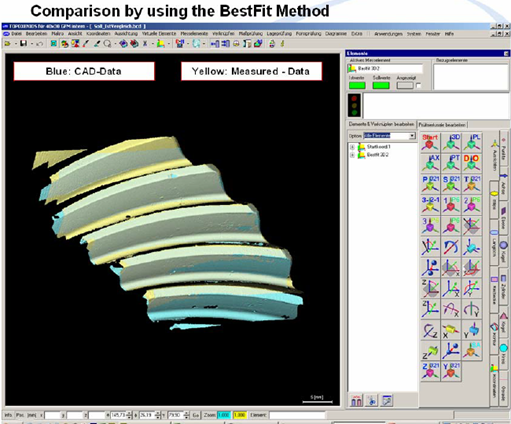

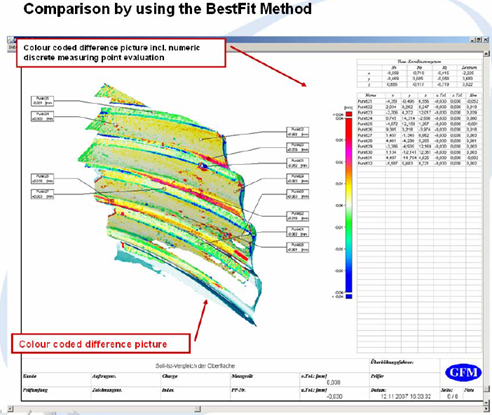

- Sistema di digitalizzazione immagini 3D a luce strutturata “strip projection”

- Dispositivi di illuminazione “multibeam”

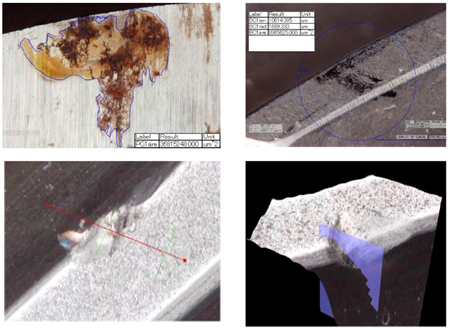

- Microscopio Digitale 3D HIROX

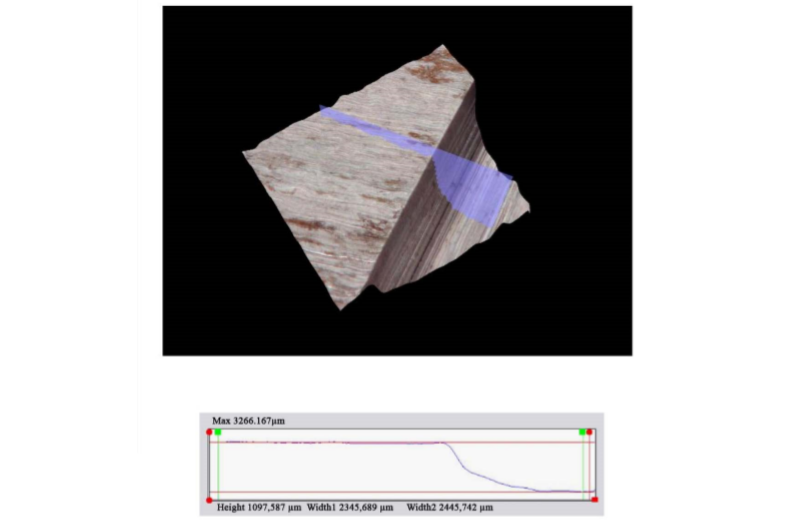

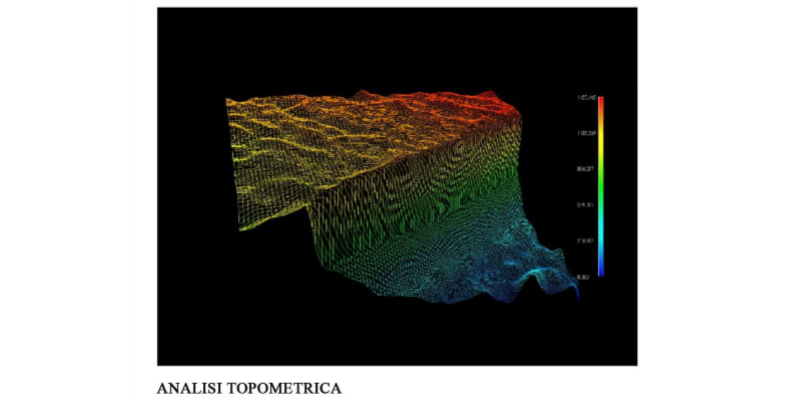

Sistema a luce strutturata “strip projection”

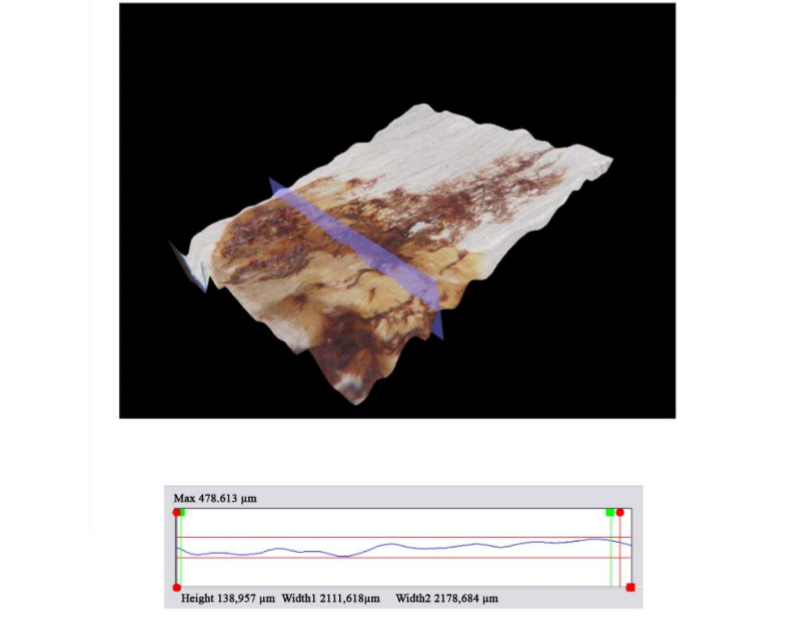

La metodologia di analisi del fenomeno di “light scattering” tramite proiezione di frange è basata sulle tecniche di triangolazione dove l’oggetto in esame è illuminato da un fascio sfasato di strisce e o linee come mostrato in figura. La funzione di misura delle frange proiettate è basata sulla rilevazione della distorsione delle linee parallele proiettate derivante dalla forma 3D della superficie in esame. Le variazioni di distribuzione, intensità, larghezza, distanza, deviazione angolare, etc. permettono di acquisire quantitativamente, con elevata risoluzione, i dati dimensionali volumetrici dell’oggetto illuminato. Dopo c.ca 5/10 sec. la trama 3D della superficie viene visualizzata sul monitor di un PC ed è possibile effettuare una serie di misure dimensionali (rugosità, planarità, profilo, eccentricità, diametri, angoli, raggi, volumi, etc.) o memorizzare i dati per eventuali successive operazioni di reverse engineering e comparazione con modelli CAD.

Il sistema è stato sperimentato allo scopo di verificare la fattibilità di rilevazione delle difettosità misurando le variazioni dimensionali dell’oggetto con sistemi di misura senza contatto a luce strutturata. La tecnica di digitalizzazione utilizzata è rapidissima e consente di digitalizzare ampie porzioni del componente e di disporre di milioni di punti dell’immagine in pochi secondi. E’ possibile, disponendo di un file CAD del componente in esame, effettuare un confronto tra i dati dimensionali 3D teorici e quelli effettivi rilevati. Tale funzione richiede però l’utilizzo di apposite utilities di reverse engineering che richiedono lunghi tempi di elaborazione; andrebbe valutata la possibilità di automazione delle funzioni necessarie al confronto programmato dei dati dimensionali. Non si esclude tale possibilità che richiederebbe comunque uno studio di fattibilità e lo sviluppo di un apposito software da sperimentare. Nelle pagine seguenti viene riportato un breve report delle acquisizioni e misure effettuate su un ingranaggio mediante un sistema a luce strutturata allo scopo di evidenziare le potenzialità del sistema.

Il microscopio digitale 3D HIROX è lo strumento più rispondente alle diversificate esigenze di inquadratura, ingrandimento, risoluzione, etc. e, data la sua compattezza e ampia gamma di dispositivi ottici di osservazione con varie angolazioni e varie caratteristiche di distanza focale, profondità di campo, lluminazione, etc. è facilmente integrabile in un sistema di visione automatizzato che per esigenze di tempistica richiederà l’impiego di “n” unità di acquisizione delle immagini con diversificate posizioni di impiego e diverse capacità di inquadratura.

l videomicroscopio HIROX nella sua configurazione modulare, ad uso manuale , semiautomatico o completamente automatico consente le seguenti operazioni di controllo:

• Osservare il campione in esame mediante luce visibile e ultravioletta (impiego di liquidi penetranti fluorescenti per l’individuazione di microcricche) • Osservare il campione in esame con luce diffusa e/o con vari angoli di incidenza • Osservare il campione in esame con ottica coassiale e/o angolata ed eventualmente con endoscopi per l’ispezione di cavità (min. diam. 1,7 mm) • Inquadrare la totalità del componente in esame e/o ingrandire eventuali particolari di interesse mediante ottica zoom ad alta risoluzione • Garantire la visualizzazione su monitor ad alta definizione di qualsiasi difettosità superficiale eventualmente rilevabile anche ad occhio nudo, in completa assenza di aberrazioni cromatiche • Scansionare la superficie mediante un dispositivo di multifocalizzazione (scanner ottico 3D) e memorizzare immagini tridimensionali utili per comparazioni CAD • Misurare e visualizzare la disomogeneità superficiale del componente / Misurare il profilo 3D su sezioni selezionabili dall’operatore • Analizzare la topografia superficiale del pezzo in esame su tutta l’area inquadrata e visualizzarla mediante nuvola di punti • Visualizzare numericamente la nuvola di punti con tabulato XYZ in formato CSV , esportabile per calcoli comparativi • Analizzare la topografia superficiale del pezzo in esame su tutta l’area inquadrata e visualizzarla mediante pseudocolori , ove a ciascun pixel colorato dell’immagine corrisponde una precisa altezza del singolo elemento del componente in esame • Filmare le acquisizioni dinamiche in formato digitale AVI

Sono disponibili varie unità ottiche Hirox integrate con telecamere CCD standard per impiego diverso in funzione del componente da esaminare, delle relative dimensioni, ingombro, profilo, tipologia di materiali e delle esigenze di controllo (rilevazione difetti, misure dimensionali, etc.)

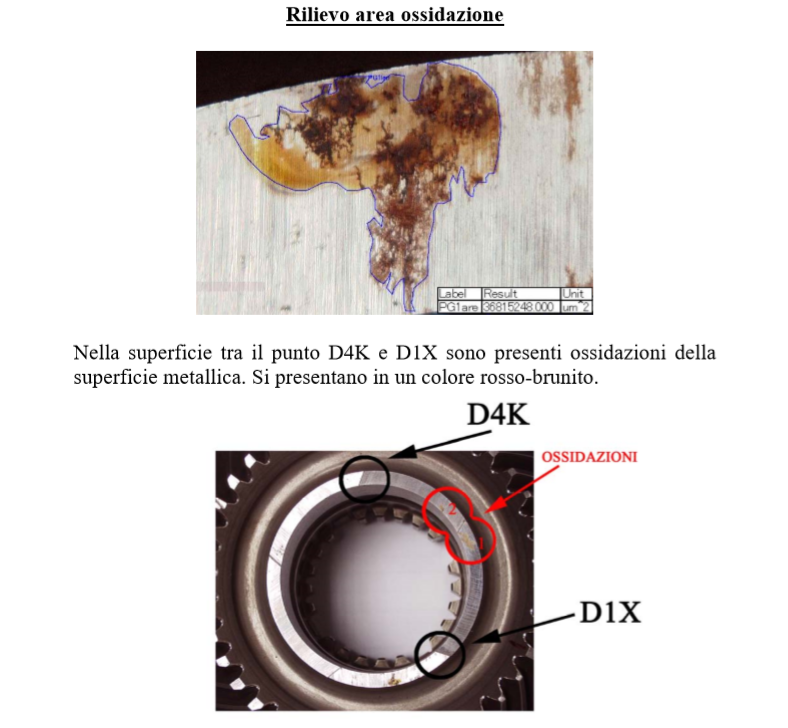

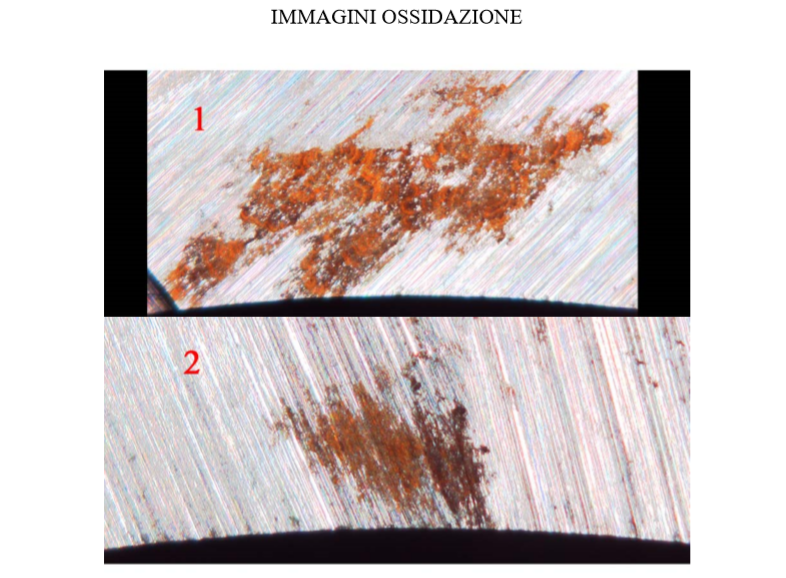

Di seguito vengono illustrati alcuni dei difetti più comuni rilevati su ingranaggi campione rilevati con il microscopio digitale 3D Hirox, che consente di ingrandire i particolari con ottica zoom in un elevato range di ingrandimenti (da 1:1 a 10.000) e di misurare tridimensionalmente i difetti rilevati. L’ispezione è stata effettuata con modalità di messa fuoco, scelta dell’ingrandimento, direzione di osservazione, angolo e intensità di illuminazione, etc. completamente automatizzati.

Sulla base dei test eseguiti e delle considerazioni di cui sopra, si ravvisa che esistono tutte le condizioni per procedere ad uno studio di fattibilità approfondito ed alla realizzazione di un dimostratore, da eseguire attraverso fasi intermedie e preliminari di progettazione, realizzazione, sperimentazione di sottoassiemi, he andranno singolarmente validati per poter essere definitivamente integrati nel sistema finale (Fase 2)

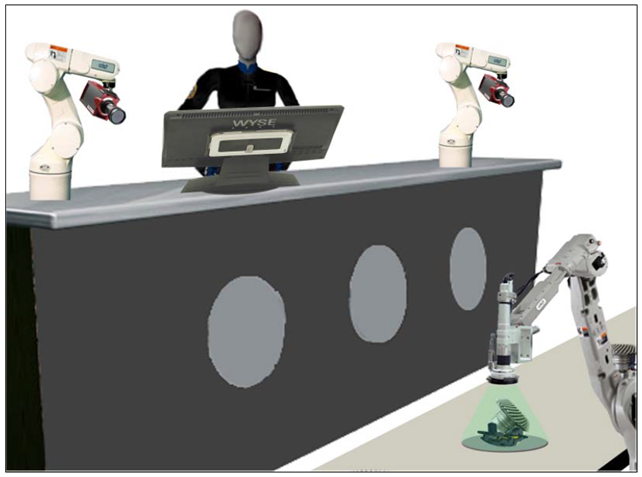

• La tecnologia da impiegare per il conseguimento degli obiettivi è rappresentata da un sistema integrato multivisione / multirobot, assistito da un olocontrollo emulativo, dotato di autoapprendimento e di “memoria esecutiva”, in grado di provvedere autonomamente alla gestione globale delle operazioni di visione dei componenti, manipolazione / scansione degli stessi e analisi delle immagini ai fini della rilevazione di difettosità superficiali

• La configurazione ed il funzionamento generale del sistema vengono di seguito sommariamente descritti

Considerazioni generali emerse nel corso dello studio di fattibilità e descrizione dell’obiettivo finale

L’obiettivo del presente progetto consiste nella messa a punto di sistemi avanzati ed integrati di controllo visivo automatico di difetti superficiali di ingranaggi durante il processo produttivo. Ci si propone, insieme ad alcune tra le migliori competenze pubbliche e private della ricerca teorica e sperimentale italiana, di sviluppare un sistema per il controllo visivo dei componenti che sia al contempo avanzato, integrato ed automatizzato, oltre che versatile nel suo utilizzo, realizzando così nei prossimi anni un forte miglioramento (in termini di produttività e/o efficienza) della capacità di discriminazione oggettiva di tutte le caratteristiche difettologiche dei componenti in oggetto. Grazie ai risultati di questa iniziativa progettuale, l’industria italiana potrà disporre di un sistema di analisi unico nel suo genere, capace di fornire un risultato “imparziale” e “oggettivo” sulla qualità del prodotto, avendo anche l’opportunità di creare e disporre di una banca dati di processo sicuramente all’avanguardia nel panorama internazionale, e assoluta se si pensa al settore specifico.

In tal modo potrà presentarsi di fronte ai mercati internazionali non soltanto come tra i leader sulla fabbricazione di ingranaggi, ma anche come utilizzatore di tecniche innovative sviluppate sinergicamente con Enti ed Aziende italiane per il controllo dei suoi manufatti. La Si.Mi.Tecno propone il progetto OLO_ROBO_VIS come una sfida tecnologica importante per i prossimi anni, cioè quella di acquisire una leadership tecnologica nell’utilizzazione di tecniche di controllo integrate e innovative per raggiungere livelli assoluti di affidabilità della propria produzione.

Il soggetto proponente è al contempo:

- Distributore esclusivo per l’Italia di Aziende multinazionali, Produttrici di apparati per il Controllo superficiale e strutturale dei materiali

- Coordinatore di un Gruppo di Imprese ed Enti altamente qualificati (laboratori condivisi) Impegnati nello studio, sviluppo e realizzazione di sistemi innovativi di visione, controllinon distruttivi e sistemi automatici integrati, forniti in oltre 40 anni di attività ad importanti Aziende del settore Aerospaziale. Il coinvolgimento del Gruppo “laboratori condivisi” costituirà un elemento qualificante al presente progetto in virtù di riconosciute competenze e dotazioni di strutture tecnico produttive articolate, idonee sia alla ricerca, sperimentazione e progettazione di sistemi di controllo integrati automatici che alla loro realizzazione, prototipazione e industrializzazione.

– caratteristiche e prestazioni da realizzare

Attualmente il controllo della difettosità superficiale di ingranaggi viene effettuato visivamente da operatori, richiedendo un elevato livello di attenzione umana ed una particolare destrezza nella manipolazione dei componenti. Il progetto consiste nella messa a punto di sistemi integrati ed automatizzati per controlli visivi adatti a tutte le tipologie di ingranaggi prodotti dai Costruttori di componenti aeronautici e in grado di rilevare tutte le tipologie di difetti rappresentate nei documenti di riferimento. Con il progetto OLO_ROBO_VIS ci prefiggiamo dunque di aumentare la vita e l’affidabilità dei componenti di fabbricazione potenziandone il livello di controllo durante la fase produttiva.

– principali problematiche di R&S

Per descrivere meglio le attività che si intende realizzare per il compimento del progetto, è di seguito riportata una tabella riassuntiva delle principali problematiche da risolvere e del tipo di intervento che si ritiene effettuare nel progetto.

Problematiche

- Rilevazioni automatiche di difetti superficiali di varia tipologia su componenti di materiale, dimensione e profilo variabile

- Manipolazione componenti

- Alloggiamento componenti

- Manipolazione sensori di scansione e acquisizione immagini

- Inquadrature

- Ingrandimenti

- Risoluzione

- Iluminazione

- Analisi e comparazione

- Rilevazione difetti

- Marcatura difetti

Soluzioni

Sistema integrato automatico composto da “n” unità di visione,autoapprendimento, emulazione, analisi, comparazione, attuazione…. con funzioni di autoregolazione e autodeterminazione delle operazioni da eseguire mediante sistema di olocontrollo.

Funzioni principali:

- Autoselezione del tipo di sensore e illuminazione propriocettiva da utilizzare in funzione dei differenti componenti

- Virtualizzazione delle aree di lavoro ed emulazione delle attività

- Intercettazione dei vari componenti e determinazione dell’ ingombro e della rispettiva posizione nell’area di lavoro (real time)

- Riconoscimento dei vari tipi di componente

- Attuazione del pre-setting propriocettivo degli slot di alloggiamento per differenti dimensioni e geometrie dei vari componenti da esaminare

Problematiche

Rilevazione delle difettosità mediante misura dimensionale (senza contatto) di varie tipologie di ingranaggio aventi dimensioni, e profilo variabile e confronto con i file CAD disponibili

Soluzioni

Sistema a luce strutturata “strip projection”

La medesima stazione di controllo utilizzata per la rilevazione di difetti superficiali potrà essere dotata di un sistema a luce strutturata in grado di digitalizzare tridimensionalmente il componente in esame e comparare la “nuvola di punti” con il modello CAD dei rispettivi componenti

Da sviluppare il confronto programmato automatico tra i dati del componente “nominali” (da file CAD) e i dati effettivi rilevati.

( FASE 1 – STUDIO DI FATTIBILITA’ –)

a) CONFIGURAZIONE DEL SISTEMA “OLO_ROBO_VIS”

a.1 Sistema di movimentazione automatica, carico/scarico dei componenti (nastro trasportatore)

a.2 Banco di lavoro provvisto di:

a.2.1 Dispositivi antivibranti

a.2.2 Pannelli isolanti e oscuranti per evitare interferenze e variabili dell’illuminazione ambientale

a.2.3 Sistema di ventilazione ed aspirazione d’aria in modo da eliminare granelli di polvere che depositandosi sui pezzi da esaminare possano dar luogo a false segnalazioni di difetti

a.2.4 Magazzino portautensili (pinze, sensori, etc.)

a.2.5 Utensili di pulizia da utilizzare qualora vengano segnalati difettosità che potrebbero essere imputabili a depositi di materiale spurio rimovibile (verificare se tale operazione viene abitualmente effettuata dall’operatore)

a.2..6 Slot elettromeccanici, pneumatici, idraulici, magnetici, etc .. in grado di alloggiare e movimentare all’interno dell’area di lavoro le varie tipologie di ingranaggio di fabbricazione AVIO S.p.A.

a.2.7 Sistemi di illuminazione ad angolo di incidenza variabile “multibeam”

a.3 “n” sensori / telecamere di acquisizione immagini (videomicroscopi)

a.4 “n” robot antropomorfi di manipolazione, scansione e marcatura (quantità, tipologia, numero di assi, etc. dipendenti dalla tipologia, dimensioni, peso, etc. dei componenti da movimentare)

a.5 Sistema di visione “attivo” per l’intercettazione, l’autoapprendimento, il riconoscimento dei componenti, la programmazione propriocettiva dei sistemi di movimentazione e olocontrollo

a.6 “n” sensori tridimensionali di acquisizione immagini (telecamere, videomicroscopi, luce strutturata, etc. / quantità, tipologia, etc. dipendenti dalla tipologia, dimensioni, etc. dei componenti da esaminare

a.7 Sistema elettronico multiassi di controllo della movimentazione

a.8 Sistema di autoapprendimento delle traiettorie dei robot di manipolazione e scansione mediante

Sistema di visione e/o file CAD

a.9 Sistema di riprogrammazione dell’assetto propriocettivo e movimentazione degli slot di alloggiamento in loop con il sistema di visione attivo

a.10 Unità centrale di pre-setting in autoapprendimento delle procedure sincrone di movimentazione e dei flussi di controllo (illuminazione variabile, scansione dei componenti, analisi immagine, etc.)

a.11 Software di interfaccia utente/macchina, parametri di analisi e sogliatura delle immagini, analisi, elaborazione, comparazione, individuazione delle difettosità, marcatura, scarto ed eventuale attuazione di dispositivi di rilavorazione

FASE 2 – STUDIO DI FATTIBILITA’

b) FUNZIONAMENTO DEL SISTEMA DI OLOCONTROLLO EMULATIVO

b.1 TRAINING DEI SOTTOASSIEMI E DEL SISTEMA GLOBALE

Addestramento del sistema di emulazione dell’ambiente “area di lavoro” tramite sistema di visione attiva / riconoscimento del componente / autoapprendimento delle traiettorie di manipolazione e scansione / attuazione guida robot / analisi delle immagini

Il sistema di olocontrollo sarà in grado di amministrare un flusso complesso di operazioni di manipolazione e controllo ed eseguire quindi autonomamente procedure di lavoro preventivamente sperimentate e validate, autoadattandosi alla variabilità geometrica e dimensionale dei manufatti previo una fase di addestramento, effettuata dall’operatore, relativa al controllo di ogni singola tipologia di componente e di difetto da rilevare.

E’ prevista infatti una “sezione di sviluppo” per l’autoapprendimento delle operazioni necessarie di ogni singolo sottoassieme funzionale del sistema.

A titolo esemplificativo, previo il periodo di addestramento multi-livello sulla propria collocazione nell’ambiente, sulla conoscenza dei componenti da manipolare e/o controllare e previo una “presa di coscienza” delle proprie capacità di muoversi ed interagire con essi, l’avvio e la fermata del robot, le accelerazioni, le velocità, le traiettorie e tutte le attività di manipolazione e controllo saranno determinati da una casualità di eventi che entrando nella sua sfera percettiva daranno luogo alla sua animazione ed all’esecuzione dei compiti preventivamente assegnati e previsti nella propria “memoria esecutiva”.

Il robot avrà alla base alcuni compiti elementari: “guardare”, “comparare”, “muoversi” , “toccare” “riconoscere”, “segnalare” , spostare..

Olocontrollo

Alla macchina configurata come una struttura cinematica e dinamica complessa integrata di tutto il repertorio elettrotecnico, elettronico e softwaristico convenzionale, viene innestato una ulteriore fase di “intelligenza emulativa”: un fronte profondo costituito da “realtà virtuale” sul quale va imprimendosi e poi riflettendosi la “realtà concreta” sotto forma di stimoli sensoriali e comandi attuatori. In questo modo, la “macchina”, completata della sua nuova sezione intelligente, autovaluta qualitativamente le proprie azioni verso un obiettivo ad essa assegnato. Ciò avviene facendo “interferire” la “realtà concreta” proveniente dalla struttura cinematica della macchina sugli oggetti che manipola, con l’altra “realtà” parallela: quella “virtuale”.Il valore “costruttivo” o “distruttivo” della “interferenza” tra i due mondi correnti, quello “concreto” e quello “virtuale”, guidano le azioni verso il raggiungimento dell’obiettivo prefissato. Ovvero, il mondo della “realtà concreta” si avvicina sempre più, fino ad eguagliarlo, al mondo della “realtà virtuale” dove si trova fin dall’avvio anche la condizione “obiettivale”. Un apparato così costituito trasforma l’attuale standard convenzionale degli apparati di controllo delle “macchine” da “itineranti preprogrammati” a “autodeduttivi”. Si passa così dal sistema detto “automazione” ad un sistema definito “autonomazione”. Cioè, con “l’automazione” è necessario preprogrammare la “macchina” registrando in essa il dettato, punto per punto, delle sue azioni che poi, “automaticamente” e “rigorosamente” ripete tutte le volte in eguale maniera. In questo caso con “l’autonomazione” basta descrivere alla “macchina” il solo “obiettivo”: essa provvede “autonomamente” ad organizzare e quindi ad utilizzare le proprie risorse per raggiungerlo, anche attraverso il superamento di eventuali ostacoli o condizioni estemporanee impreviste.

b.1.1 Addestramento di emulazione dell’ambiente “area di lavoro” per l’intercettazione, classificazione, riconoscimento del componente, attuazione dei dispositivi di manipolazione e controllo e virtualizzazione di scene dinamiche

Verrà utilizzato un “sistema di visione attivo”, simile a quelli utilizzati per videosorveglianza.. A partire da una scena statica (area di lavoro vuota) il sistema verrà addestrato a segnalare l’intrusione di un componente nell’area di lavoro e ad attivare contemporaneamente all’evento tutti i dispositivi automatici disponibili.

Il sistema assegnerà un codice diverso per ciascun componente intercettato in base ad alcuni parametri caratteristici dell’immagine (dimensioni di ingombro, profilo dei bordi, etc.) o altri dispositivi identificativi (marker, codici a barre, serial number stampigliati, tag, etc.)

Tale dispositivo avrà quindi la funzione di “riconoscere” successivamente le varie tipologie di componente e predisporre propriocettivamente i robot alle relative operazioni di manipolazione e controllo.

L’EMULAZIONE VIRTUALE DELL’AMBIENTE

Basata sugli studi dinamico-funzionali della macchina biologica, l’emulazione virtuale si configura come risposta tecnologica innovativa, in particolare aprendo nuove possibilità di monitoraggio dinamico in tempo reale, caratterizzazione biunivoca dei materiali, comparazione automatica dei risultati di controllo e valutazioni “autonome della macchina” , laddove è necessario interpretare i dati rilevati con differenti tecniche di indagine.

Grazie a tecniche di acquisizione e trasferimento dati su reti parallele, simili alle reti neurali, l’olocontrollo emulativo consente l’integrazione e la gestione globale di una grande quantità di dati, attraverso un continuo confronto tra stati di riferimento e stati “attuali” rilevati strumentalmente.

b.1.2 Addestramento del sistema per autoapprendimento delle traiettorie di manipolazione e scansione (guida robot)

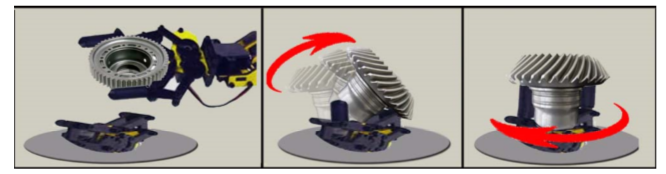

La prima volta, per ciascuna tipologia di componente e di difettosità da rilevare, con l’ausilio di tastiera e joy stick del PC di bordo, l’operatore sposterà il componente codificato tramite un robot antropomorfo di manipolazione e posizionerà le varie facce da esaminare di fronte al microscopio o alla telecamera di acquisizione (e/o preleverà il videomicroscopio dal “magazzino utensili” e lo utilizzerà come scanner sul pezzo scegliendo le migliori inquadrature per una ottimale visione e per una completa “copertura” dell’intera superficie) quindi lo riporterà nel magazzino in posizione di riposo e attesa di nuovo input.

In una serie di casi, in funzione del tipo di componente, per esigenze di velocità e per garantire la completa scansione, sarà previsto il suo posizionamento su appositi slot mobili , pinze o tavole rotanti, etc. (dotate di encoders)

Tali operazioni verranno memorizzate dal sistema il quale successivamente “riconoscerà” il componente ed effettuerà automaticamente e autonomamente, alla massima velocità tutte le operazioni effettuate manualmente la prima volta dall’ operatore.

b.1.3 Addestramento del sistema per autoapprendimento delle modalità di regolazione dei

dispositivi di illuminazione multipla per ciascun componente

Per ogni tipologia di componente e per ogni inquadratura l’operatore provvederà ad illuminare il componente con luce diffusa o focalizzata ed a varie intensità per evitare problemi di abbagliamento, saturazione e/o riflessioni spurie, inoltre utilizzerà varie angolazioni in modo da evidenziare eventuali difettosità visibili soltanto in condizioni di illuminazione radente o con un preciso angolo di incidenza.

Tali operazioni verranno memorizzate dal sistema il quale successivamente, per ogni tipologia di componente effettuerà automaticamente la sequenza di operazioni eseguite manualmente la prima volta dall’ operatore.

Immagini ad illuminazione multipla

Le proprieta’ foto-cromatiche apparenti di un materiale dipendono dalle sue proprieta’ geometriche e strutturali e cambiano al variare dell’angolo di incidenza della sorgente di illuminazione rispetto ad un osservatore fisso. Una superficie che appaia diffusiva con un angolo di illuminazione a 45° rispetto ad un punto di osservazione fisso mostra la sua natura riflettente se la sorgente di illuminazione viene avvicinata all’angolo di riflessione speculare (Figura 1).

Figura 1. Geometria generale del problema e relazione tra geometria della superficie osservata e l’immagine registrata dall’osservatore.

Una sorgente radente alla superficie del manufatto in esame ne evidenzia invece le proprieta’ geometriche locali – es. curvatura, rugosita’, solcature, tagli. Anche le proprieta’ cromatiche (tinta, intensita’, saturazione del colore) possono variare al variare dell’illuminazione, specialmente nei materiali cosiddetti anisotropi – quali i tessuti di raso, che i maestri di sartoria compongono in complesse piegature e sbuffi su maniche e spalle per produrre un’ampia gamma di effetti cromatici.

Le variazioni osservate nelle immagini sono univocamente determinate una volta che siano state determinate le caratteristiche geometriche e fisiche del manufatto. Di ben piu’ difficile soluzione e’ invece il problema inverso, cioe’ la determinazione delle caratteristiche del materiale a partire da un insieme finito di immagini acquisite con diversi angoli di illuminazione. Lo studio delle immagini ad illuminazione multipla si occupa specificamente della ricerca delle condizioni teoriche che permettano di risolvere il problema inverso. Tali condizioni determinano i vincoli progettuali di un sistema di stima delle caratteristiche dei materiali. Determinate le caratteristiche del materiale, e’ possibile identificare i difetti di produzione come anomalie delle caratteristiche rispetto ad un comportamento “ideale” del materiale. Tale identificazione e’ effettuata dal calcolatore mediante algoritmi di identificazione/classificazione basati su tecniche di intelligenza artificiale.

Figura 1. (a): due diversi angoli di illuminazione mostrano diversi particolari del rilievo (b) l’illuminazione variabile mette in evidenza le proprieta’ riflettenti (gloss, matte) delle vernici applicate alla maschera.

Sistema di acquisizione

Teoricamente, il problema inverso e’ banalmente risolto se sono disponibili un numero infinito di sorgenti luminose, disposte uniformemente in una sfera attorno all’oggetto in esame (visual hull). Tale soluzione e’ ovviamente di interesse puramente teorico, in quanto un sistema realizzabile dovra’ avere necessariamente un numero limitato di sorgenti luminose. I vincoli riguardano anche i tempi di elaborazione: un maggior numero di sorgenti comporta l’acquisizione e l’elaborazione di ulteriori immagini. Inoltre le preesistenti geometrie dei macchinari e della catena di produzione, le necessita’ ergonomiche ed i costi sono tutti fattori determinanti per la realizzazione del sistema reale.

In particolare, cio’ e’ vero per le superfici “quasi” bidimensionali, quelle cioe’ in cui il rilievo superficiale ha dimensioni minori di almeno un ordine di grandezza rispetto all’estensione piana dell’oggetto. Oggetti dalle forme complesse e circonvolute richiedono invece numerose sorgenti, ed in alcuni casi il problema inverso e’ mal-posto e non risolvibile.

Fortunatamente, i semi-lavorati sulla superficie presentano caratteristiche di quasi-bidimensionalita’ in quanto sia il rilievo del manufatto – scaglie, buccia d’arancia, satinatura – che i suoi difetti – strappi, tagli, perforazioni – hanno scala geometrica ridotta rispetto all’estensione planare tipica di un semilavorato in pelle.

Altre caratteristiche di interesse, perdita di lucentezza, alterazioni cromatiche etc sono intrinsecamente bidimensionali e pertanto richiedono un numero minimo di sorgenti.

In questo lavoro presentiamo due possibili prototipi del sistema d’acquisizione, rispondenti a due possibili ipotesi di processo produttivo.

Acquisizione semisferica

Nel sistema ad acquisizione semisferica le sorgenti di illuminazione sono poste su una ai vertici delle radianti dipartenti dal centro del piano immagine, a distanza costante dal centro stesso, e intendenti angoli solidi uniformi (figura). La distanza sorgenti-centro e’ tale da garantire sufficiente illuminazione del manufatto, e fronte luminoso sufficientemente piano. A tal proposito le sorgenti possono essere focalizzate e schermate con filtri diffusori. Una configurazione ragionevolmente minima prevede 24 sorgenti. In questo modo e’ possibile campionare il soggetto su 8 angolazioni orizzontali spaziate di 45° e 3 elevazioni, rispettivamente 0° (radente), 45° (diffusa) e 90° (incidente).

Tale sistema garantisce elevata accuratezza ma comporta tempi di elaborazione non sempre compatibili con i vincoli di produzione.

Inoltre la geometria del sistema di acquisizione, priva di accessi al di fuori della apertura della semisfera, puo’ presentare problemi di integrazione con i macchinari pre-esistenti, in quanto richiede di essere “calata dall’alto” sul campione.

Acquisizione “in linea” (semicilindrica)

Per risolvere i potenziali problemi di calcolo e integrazione del sistema semisferico, nel sistema “in linea” si utilizzano sorgenti luminose lineari – piuttosto che puntiformi) poste su generatrici equi-spaziate di una superficie cilindrica. In questo caso il numero minimo di sorgenti si riduce a 5 – corrispondenti alle elevazioni 0°, ±45°, ±90° – con una riduzione di un fattore 8 nei tempi di calcolo rispetto al sistema semisferico. Inoltre si garantisce una “bocca di accesso” al sistema di acquisizione attraverso cui i manufatti possono essere introdotti mediante carrello scorrevole o nastro trasportatore.

Rispetto al sistema semisferico, il sistema in “linea” riduce il tempo di calcolo a scapito dell’accuratezza della misura. Per una larga classe di difetti tale perdita potrebbe essere accettabile a fronte di una maggiore velocita’ di esecuzione.

Figura 3. (a) acquisizione semisferica e accesso al soggetto osservato. (b) acquisizione semicilindrica

Elaborazione numerica ed applicazioni

Le immagini digitali acquisite, in numero pari al numero di sorgenti luminose, viene trasferita in un calcolatore (generico PC o sistemadedicato) ed elaborata numericamente con tecniche di detezione e classificazione basate su algoritmi di intelligenza artificiale. Ilrisultato di tale elaborazione e’ l’identificazione e localizzazione dei difetti e la segnalazione ad un sistema di controllo della linea o ad operatore umano. In quest’ultimo caso, idealmente il programma presenta all’operatore una visione “aumentata” (Enhanced vision) del difetto in esame determinando digitalmente la combinazione di sorgenti di illuminazione che meglio evidenzi la struttura e le caratteristiche del difetto in esame.

E’ infatti possibile in molti casi creare digitalmente un’immagine che simuli una determinata direzione di illuminazione a partire da

immagini acquisite con direzioni adiacenti a quella di interesse. In questo modo l’operatore e’ in grado di prevedere il comportamento del manufatto in condizioni di illuminazione ragionevolmente arbitrarie senza dover fisicamente operare su esso o sulle sorgenti luminose.

Esempio da altri lavori svolti su diversi materiali

I test sono stati rivolti a verificare la possibilità di utilizzare un approccio di nuova concezione per l’analisi industriale di difetti di smaltatura basato su tecniche di ricostruzione della funzione di riflessione della superficie. I primi risultati mostrano una eccellente capacità di rivelazione dei difetti nonostante le larghe tolleranze nel set-up sperimentale realizzato in primissima istanza con strumentazione largamente sottodimensionata rispetto alle esigenze di qualità di una verifica di processo industriale. Questo dimostra aposteriori la robustezza della metodologia che si intende applicare e giustifica la possibilità di operare ulteriori sforzi nella direzione

(a) (b) Fotocamera digitale, Soggetto osservato

La tecnica si basa sull’acquisizione di una sequenza di immagini con diverse condizioni di illuminazione che permettono di osservare la smaltatura con differenti angoli di incidenza della luce; sulla linea di produzione questo può essere realizzato con estrema precisione e rapidità utilizzando diverse sorgenti luminose pilotate in sequenza. L’acquisizione delle immagini avviene mediante singola telecamera in posizione fissa.

A questa metodologia sarà affiancata una serie di tecniche di analisi delle immagini che permetteranno da un lato di pre-processare le immagini per migliorarne la qualità e per rendere ancora più sensibile il sistema di rilevazione dei difetti, dall’altro daranno la possibilità verificare direttamente sulla linea anche forma e posizione delle lamiere che potranno anche essere in parte confrontate con modelli CAD/CAM forniti.

Difetti chiaramente evidenziati anche se di piccole dimensioni

b.1.4

Addestramento del sistema per analisi delle immagini e rilevazione di discontinuità superficiali; Il sistema verrà addestrato a riconoscere, classificare e segnalare la difettosità , utilizzando tecniche integrate di somma/differenza di immagini, analisi topometrica, comparazione dimensionale, reti neurali , etc.

Le discontinuità superficiali saranno sempre evidenziate grazie alle significative variazioni di contrasto dell’immagine dovute ai diversi angoli di incidenza della luce provenienti dai dispositivi di illuminazione multipla

E’ stato impiegato un sistema semisferico di lampade a LED per la verifica degli algoritmi utili per la sperimentazione. Nella figura a lato è possibile vedere la struttura delle lampade disposte su di una calotta semisferica di raggio pari a circa 20cm.

Il sistema permette di acquisire delle immagini ad oltre 8 bit mediante un sistema di multi esposizione.

Il kit di sviluppo software è stato concepito per il controllo dell’acquisizione e la registrazione dell’angolo di provenienza della luce.

E’ possibile anche utilizzare una metodologia che non prevede una ricostruzione della normale alla superficie ma che si basi sul differente comportamento dei punti rispetto ad un comportamento atteso. Nelle immagini seguenti, infatti, si può osservare come il difetto indicato dal cerchio giallo ha un comportamento dell’illuminazione diverso da quello della superficie a cui appartiene.

Questo tipo di ricostruzione è ancora più rapida rispetto alla precedente che pure ha dei tempi di calcolo ragionevoli per una ispezione del pezzo in tempo reale, inferiore alla decina di secondi.

La capacità discriminante non è nel distinguere le diverse intensità luminose presenti nelle immagini, ma nell’analizzarne le variazioni! L’intensità di colore cambia in modo anomalo rispetto ad un pattern atteso o rispetto ad un modello di riflessione

In definitiva il sistema di olocontrollo consentirà per tutte le operazioni effettuate manualmente:

- manipolazione dei componenti

- scelta/prelevamento del tipo di telecamera/videomicroscopio/sensore di acquisizione

- traiettorie di scansione

- ingrandimenti, risoluzione, analisi dei difetti

- marcatura

- scarto

- etc.

l’esecuzione automatica del collaudo visivo con indice di fallibilità simile a quello di un operatore qualificato, con garanzie di continuità, ripetibilità e cadenza di controllo rapportate alla produttività della fabbrica

Note:

Sottoassiemi del sistema possono essere collocati direttamente presso le macchine di lavorazione e gestiti remotamente dall’unità di olocontrollo centrale.

Apparecchiature attualmente piu’ performanti per l’esecuzione dei controlli sopradescritti

- CONTROLLI DI VARIAZIONI DIMENSIONALI: SISTEMA A LUCE STRUTTURATA POLYSCAN

CONTROLLI DI DIFETTOSITA’ SUPERFICIALI: MICROSCOPIO DIGITALE HIROX HRX01

+ Info: m.brecciaroli@simitecno.it